# Instalar pacman se necessário - ele gerencia os demais

if (!require("pacman")) install.packages("pacman")

# Instalar e carregar todos os pacotes da apostila

pacman::p_load(

tidyverse, # manipulação e visualização

psych, # estatísticas descritivas detalhadas

car, # testes de pressupostos

nortest, # testes de normalidade

DescTools, # assimetria, curtose e tamanho de efeito

knitr, # tabelas formatadas

kableExtra, # formatação avançada de tabelas

effectsize, # tamanho de efeito (Cohen's d, eta², omega²)

nlme, # modelos mistos

corrplot, # visualização de matrizes de correlação

rstatix, # testes em pipelines tidyverse

broom # resultados de modelos em formato tidy

)Estatística com R

Conceitos, aplicações e boas práticas

Estatística com R

Conceitos, aplicações e boas práticas

Jennifer Lopes - Café com R

A estatística nunca foi tão necessária

Vivemos um momento singular na história do conhecimento. Ferramentas de inteligência artificial geram textos, interpretam dados, produzem análises e respondem perguntas com uma fluência que, há poucos anos, seria inimaginável. Esse avanço é real, relevante e transformador. Mas ele traz consigo um risco igualmente real: a ilusão de que entender números é algo que pode ser delegado a uma máquina.

A estatística nunca foi tão importante quanto agora - precisamente porque nunca foi tão fácil obter um resultado sem compreendê-lo.

Qualquer algoritmo de machine learning é, em sua essência, uma construção estatística. Qualquer modelo de linguagem foi treinado com métricas de avaliação que dependem de fundamentos probabilísticos. Qualquer dashboard gerado automaticamente exige que alguém saiba fazer as perguntas certas - e saiba questionar as respostas. Sem formação estatística sólida, o analista se torna dependente de ferramentas que não consegue auditar, de resultados que não consegue questionar e de conclusões que não consegue defender.

A estatística é a linguagem da evidência. É o que nos permite distinguir padrão de ruído, associação de causalidade, significância estatística de relevância prática. Em um mundo saturado de dados e de respostas geradas automaticamente, essa capacidade de leitura crítica não é um diferencial - é um requisito.

Essa necessidade atravessa todas as áreas do conhecimento. Na medicina, decisões clínicas dependem da interpretação correta de ensaios randomizados, curvas de sobrevivência e intervalos de confiança. Na biologia, experimentos com organismos vivos exigem ANOVA, testes de pressuposto e avaliação de tamanho de efeito. Nas ciências sociais, pesquisas de opinião e estudos observacionais dependem de amostragem, ponderação e testes de hipótese. Na economia, modelos de regressão sustentam políticas públicas. No jornalismo de dados, a interpretação incorreta de uma correlação pode disseminar desinformação em escala. Em todas essas áreas, a estatística é o que transforma dado em argumento e argumento em conhecimento.

Sobre esta apostila

Esta apostila está em sua versão 1 - inicial. Ela foi construída originalmente como material de apoio para uma mentoria realizada com alunos de graduação em 2025. Naquele contexto, o objetivo era oferecer uma base sólida e prática de estatística aplicada com R, suficiente para que os alunos conseguissem conduzir suas próprias análises com autonomia e rigor.

Agora, esse material está sendo revisado, expandido e organizado em formato de livro aberto para alcançar um público mais amplo.

O que esta versão já oferece:

- Fundamentos de estatística descritiva e inferencial com código reproduzível em R

- Limpeza e preparação de dados - etapa mais negligenciada na formação estatística

- Testes paramétricos e não paramétricos com critérios claros de escolha

- Correlação com distinção entre Pearson e Spearman e discussão sobre causalidade

- ANOVA one-way, two-way e introdução a modelos mistos

- Regressão linear com diagnóstico completo de resíduos

- Tamanho de efeito - Cohen’s d, eta-quadrado e omega-quadrado

- Visualização avançada com ggplot2

- Comunicação de resultados para públicos técnicos e não técnicos

O que ainda está por vir nas próximas versões:

Esta versão é intencional em seus limites. Dois blocos importantes estão planejados e serão incorporados nas atualizações:

- Análise multivariada: PCA (análise de componentes principais), análise de clusters, análise discriminante e técnicas de redução de dimensionalidade - essenciais para quem trabalha com dados de alta complexidade

- Projetos com dados públicos e abertos: aplicações com datasets brasileiros reais do IBGE, SIDRA, Portal da Transparência e bases de saúde pública, tornando a prática ainda mais próxima dos problemas reais do mercado e da pesquisa nacional

Também estão previstas para versões futuras referências bibliográficas mais completas, imagens e ilustrações de apoio conceitual e exercícios com gabarito comentado.

Esta é a versão 1 da apostila - um material funcional, com código testado e conteúdo revisado, mas ainda em construção. Se você encontrar erros, tiver sugestões ou quiser contribuir, o material é open source.

Como usar esta apostila

O conteúdo parte do pressuposto de que você já possui familiaridade básica com a linguagem R e com o RStudio. Se ainda está nos primeiros passos, recomenda-se consultar as aulas introdutórias do Café com R antes de prosseguir.

O fio condutor de todos os capítulos é o dataset CO2, nativo do R, que registra dados de um experimento sobre tolerância ao frio em plantas de Echinochloa crus-galli. Esse dataset foi escolhido por ser rico o suficiente para ilustrar todos os métodos, mas simples o suficiente para manter o foco nos conceitos estatísticos.

Cada capítulo é independente para fins de consulta, mas a leitura sequencial é recomendada para quem está aprendendo pela primeira vez. O código de todos os exemplos é funcional e reproduzível - execute no RStudio enquanto lê.

Os callouts ao longo do texto seguem a seguinte convenção:

Definições e fundamentos teóricos essenciais para a compreensão do tópico.

Recomendações consolidadas para análise de dados de qualidade.

Erros comuns, limitações e armadilhas frequentes que analistas cometem.

Conexão do conceito com demandas reais da indústria ou da ciência.

Conteúdo programático

| Capítulo | Tema | Nível |

|---|---|---|

| 1 | Introdução: conceitos e contexto | Básico |

| 2 | Limpeza e preparação de dados | Básico-Intermediário |

| 3 | Estatística descritiva | Intermediário |

| 4 | Distribuições de probabilidade e normalidade | Intermediário |

| 5 | Testes não paramétricos | Intermediário |

| 6 | Correlação | Intermediário |

| 7 | ANOVA: análise de variância | Intermediário-Avançado |

| 8 | Regressão linear e diagnóstico | Avançado |

| 9 | Tamanho de efeito | Intermediário-Avançado |

| 10 | Visualização avançada | Intermediário |

| 11 | Comunicação de resultados | Intermediário |

| 12 | Próximos passos | Referência |

Pacotes utilizados

Todo o código desta apostila utiliza pacotes disponíveis no CRAN. Para instalar todos de uma vez:

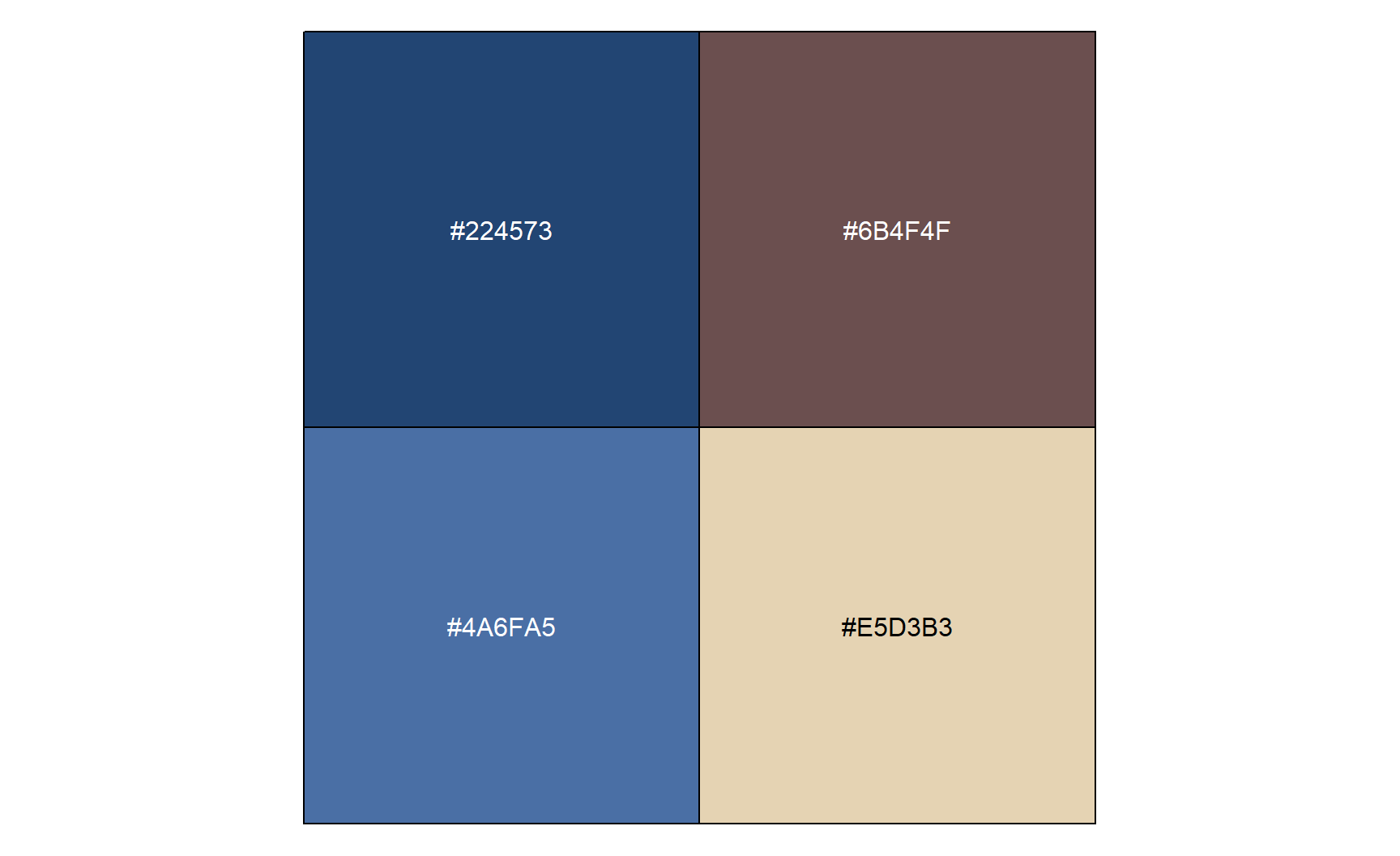

Paleta de cores

A paleta utilizada nos gráficos desta apostila é consistente com a identidade visual do Café com R:

cores_cafe <- c(

azul_escuro = "#224573",

marrom = "#6B4F4F",

azul_claro = "#4A6FA5",

bege = "#E5D3B3")

scales::show_col(cores_cafe)

Esta apostila faz parte do projeto Café com R. É open source - use, estude e compartilhe.